Detetives de internet usam IA para “revelar” o atirador de Charlie Kirk, mas a verdade pode estar sendo fabricada

Como ferramentas de IA estão transformando fotos borradas em “provas visuais” , e fabricando suspeitos que talvez nunca tenham existido

Detetives de internet usam IA para “revelar” o atirador de Charlie Kirk, mas a verdade pode estar sendo fabricada

Quando o Federal Bureau of Investigation divulga fotografias borradas de uma pessoa de interesse em um caso de violência, é previsível que pessoas com acesso a ferramentas de inteligência artificial tentem “aperfeiçoar” essas imagens. Mas até onde chegam as melhorias e onde começa a ficção?

Resumo do fato

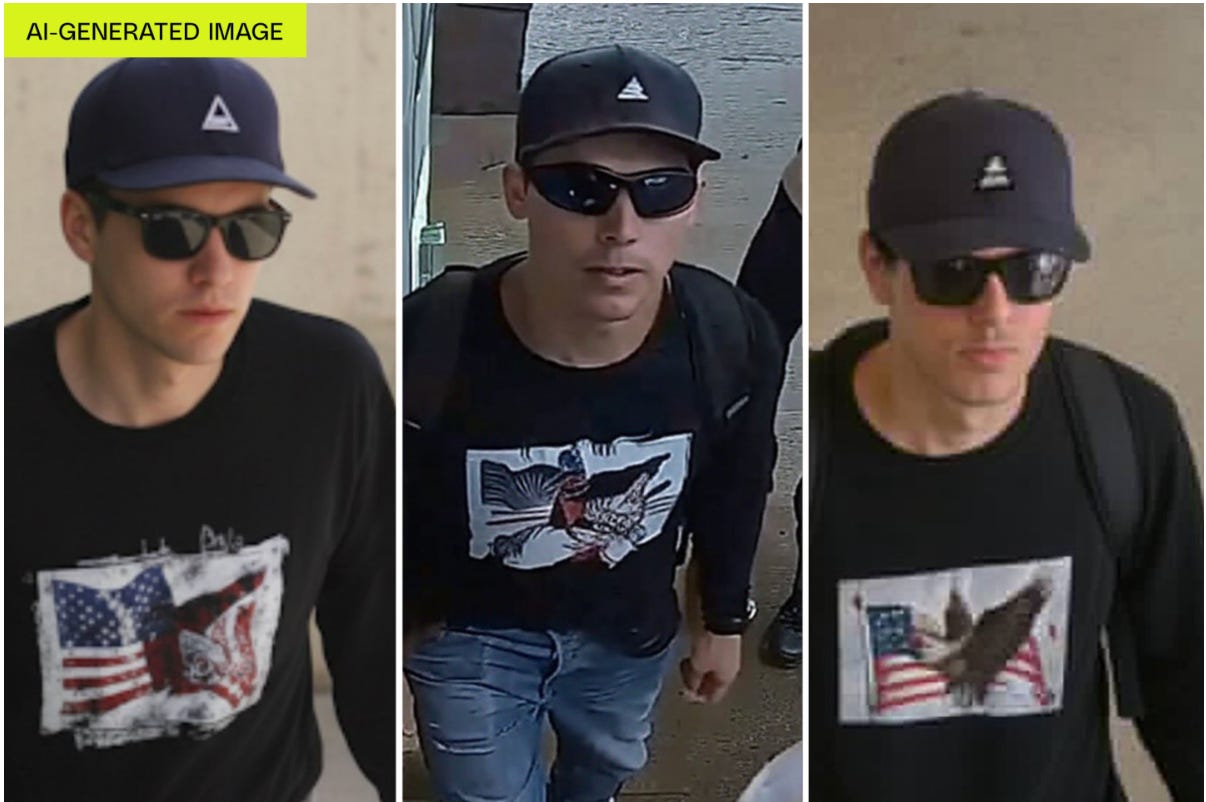

O FBI publicou duas fotos de vigilância de uma pessoa de interesse no tiroteio que envolveu o ativista Charlie Kirk. As imagens estavam pixeladas e com baixa definição. Poucas horas depois, várias pessoas online começaram a “melhorar” essas fotos usando IA. As ferramentas geraram versões com rostos mais definidos, traços nítidos e roupas alteradas, com estruturas faciais que não apareciam no original. Algumas versões se tornaram virais, mesmo que claramente mostrassem detalhes inexistentes. Essas “melhorias” não revelam fatos ocultos. Elas criam conjecturas plausíveis com base em padrões aprendidos pela IA.

Bastidores

Assim que as fotos foram postadas, usuários começaram a usar bots e serviços públicos de IA para gerar versões em alta resolução. Alguns usaram plataformas integradas ao Grok no X, outros usaram ferramentas de modelos como o ChatGPT ou softwares de upscaling de imagens. Essas ferramentas recebem a imagem de baixa qualidade, tentam preencher os pixels faltantes e suavizam bordas, cores e sombras.

Essas ferramentas não sabem o que está realmente nos detalhes omitidos. Elas inferem com base nos dados com que foram treinadas. Se muitos rostos em imagens de treino têm certas proporções faciais, a IA “acha” algo parecido. Se nunca viu uma combinação incomum de roupas e sombras, pode inventar algo plausível, mas que não corresponde ao original.

Contexto + Ruptura

Esse uso de IA gerou críticas porque, em casos policiais ou judiciais, uma foto viral pode influenciar público, testemunhas e até investigações. A falsa certeza visual tem peso psicológico enorme. Ver algo mais claro na internet, com suposta nitidez, leva pessoas a acreditarem que aquilo é real e que existem provas visuais de culpabilidade ou inocência.

Há casos em que IAs de upscaling criaram objetos ou características que distorcem identidades, alterando cor da pele, traços faciais, sombras que parecem armas ou rostos, tudo porque o algoritmo tenta completar dados faltantes com base em padrões estatísticos e não em evidências.

Ferramentas e técnica

Os modelos de upscaling ou super-resolução usam redes neurais para transformar uma imagem de baixa resolução em outra mais refinada. Exemplos são ESRGAN, Real-ESRGAN e modelos integrados a apps ou serviços online.

Modelos de geração de imagem condicionada preenchem partes borradas da imagem com base no contexto visual ou em descrições fornecidas.

As redes convolucionais, adversariais e módulos de atenção detectam bordas, rostos, texturas e luzes para decidir como reconstruir áreas com ruído ou pixels faltando.

Essas ferramentas dependem de grandes conjuntos de dados de treinamento. Quanto mais variado for o dataset, mais provável que a IA generalize bem, mas também mais provável que introduza suposições quando não houver dados suficientes.

Quando a IA inventa detalhes

Quando uma parte da imagem está muito borrada ou ausente, a IA cria formas plausíveis. Pode suavizar contornos faciais, gerar cabelo “idealizado”, inserir roupas padrão, ajustar sombras e texturas que parecem realistas, mas que nunca existiram. Em alguns casos, muda a cor da pele, o formato do rosto, as proporções e até expressões faciais.

Esses detalhes inventados podem gerar desinformação e acusações erradas. Uma “melhoria” pode tornar viral uma versão que parece mais convincente que a original e influenciar testemunhas ou investigações.

Projeção + Spoiler do Futuro

Se essa prática continuar sem regulação, muitos casos de “correções visuais” podem ser assumidos como verdades em processos criminais. Pode surgir pressão para regulamentar o uso de IA em evidências visuais, com normas que definam quando uma imagem melhorada pode ser usada em investigações. Plataformas podem passar a exigir avisos como “esta imagem foi modificada com IA” e exibir o original ao lado.

Também pode surgir um tribunal de opinião pública antes mesmo de qualquer investigação formal, com versões visuais virais influenciando julgamentos morais e online.

Cliffhanger final

A pergunta que fica é quem será responsabilizado quando uma imagem aperfeiçoada com IA leva à injustiça pública ou aponta o dedo para a pessoa errada.

Para saber mais sobre casos assim e os bastidores que ninguém espera sigam a Tech Gossip se quiserem saber mais

#ImagemNãoÉProva #UpscalingEnganoso #VerdadesOuIlusões #IAsemFiltro #InvestigaçõesVisuais #ia